دراسات أولية تكشف عن قلق غير مبرر من تقييم ChatGPT Health لبيانات اللياقة البدنية

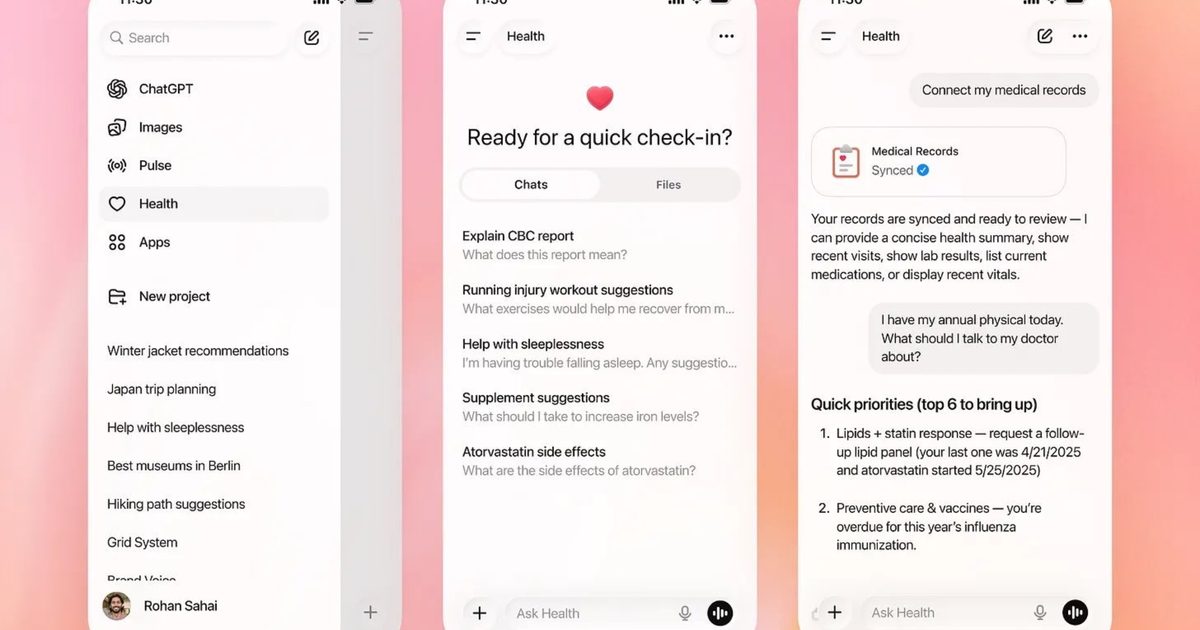

أطلقت شركة OpenAI ميزة جديدة ضمن ChatGPT تركز على الرعاية الصحية، تهدف إلى توفير بيئة آمنة للمستخدمين للاستفسار عن مسائل طبية حساسة تشمل البيانات الصحية والأمراض واللياقة البدنية. تتيح هذه الميزة للمستخدمين ربط تطبيقات تتبع الصحة مثل Apple Health وMyFitnessPal وPeloton، مما يسهل تحليل البيانات وتقديم رؤى مخصصة. ومع ذلك، تشير التقارير الأولية إلى أن فعالية هذه الميزة في توفير معلومات دقيقة وموثوقة قد تكون مبالغًا فيها.

في وقت سابق من الشهر، بدأت OpenAI في طرح هذه الأداة الجديدة، ما أثار اهتمامًا واسعًا في مجالات التكنولوجيا والرعاية الصحية. تهدف هذه الخطوة إلى استغلال قدرات الذكاء الاصطناعي لتقديم معلومات صحية شخصية، لكنها أيضًا تثير تساؤلات حول دقة وموثوقية هذه المعلومات. وقد أبدت تقريرات حديثة قلقًا بشأن قدرة ChatGPT Health على تقديم تقييمات صحية موثوقة استنادًا إلى البيانات المدخلة.

تقييمات صحية غير دقيقة من ChatGPT Health

- قدم ChatGPT Health تقييمًا بدرجة “F” لصحة القلب لمراسل صحيفة واشنطن بوست بعد تحليل بياناته من Apple Health على مدار عشر سنوات.

- نفى طبيب قلب صحة هذا التقييم، مشيرًا إلى أن خطر إصابة المراسل بأمراض القلب منخفض للغاية، مما يعكس تناقضًا يثير تساؤلات حول موثوقية الأداة في اتخاذ القرارات الصحية.

الاعتماد على مقاييس غير موثوقة

- وفقًا للدكتور إريك توبول من معهد سكريبس للأبحاث، فإن أداة ChatGPT Health ليست مناسبة لتقديم استشارات طبية.

- تعتمد الأداة بشكل كبير على تقديرات من الساعات الذكية مثل Apple Watch، التي تُعرف بأنها قد تحتوي على قياسات غير دقيقة لمعدل VO2 max وتقلب معدل ضربات القلب.

تشير دراسات مستقلة إلى أن تقديرات Apple Watch لمعدل VO2 max غالبًا ما تكون منخفضة، بينما Treat ChatGPT Health هذه التقديرات كمعايير واضحة على سوء الحالة الصحية، مما يؤدي إلى تقييمات وتوصيات غير دقيقة.

تضارب في النتائج

- اختبارات أخرى أظهرت تباينًا في النتائج، حيث تراوحت تقييمات ChatGPT Health بين “F” و “B” على مدار محادثات مختلفة.

- في بعض الحالات، تجاهلت الأداة تقارير اختبارات الدم الحديثة أو تناست تفاصيل هامة مثل عمر وجنس المراسل.

كذلك، قدم نموذج Claude للرعاية الصحية من شركة Anthropic نتائج متضاربة، تراوحت بين “C” و “B” ناقص، مما يثير قلقًا حول موثوقية هذه الأدوات وقدرتها على توفير تقييمات صحية متسقة.

أكدت كل من OpenAI وAnthropic أن أدواتهما لا تهدف إلى استبدال الأطباء، بل لتقديم سياق عام. بيد أن تقديم تقييمات شخصية عن صحة القلب والأوعية الدموية، مع تباين النتائج، قد يؤدي إلى قلق المستخدمين الأصحاء أو لتطمين غير الأصحاء بشكل خاطئ. يعتبر الذكاء الاصطناعي في الرعاية الصحية مجالًا واعدًا، لكن هذه النتائج الأولية تشير إلى أن الاعتماد فقط على بيانات اللياقة البدنية المدخلة يمكن أن يُفضي إلى مزيد من الحيرة بدلًا من الوضوح.

تحليلات البيانات الصحية

- تعتبر تحليلات البيانات الصحية مجالًا معقدًا يتطلب خبرة طبية متخصصة.

- بينما يمكن أن تكون هذه الأدوات مفيدة في تتبع الاتجاهات العامة، إلا أنها لا ينبغي أن تُستخدم كبديل للتشخيص الطبي المهني.

- تتطلب تطبيقات الصحة الرقمية رقابة مستمرة لضمان دقتها وموثوقيتها.

من المتوقع أن تعمل OpenAI وAnthropic على مراجعة وتحسين خوارزمياتها استنادًا إلى هذه النتائج الأولية، مع التركيز على تعزيز دقة التقييمات وتقليل التباين في النتائج. سيواصل الخبراء متابعة التطورات المستقبلية في هذا المجال لتقييم إمكانيات الذكاء الاصطناعي في تحسين الرعاية الصحية، مع التشديد على أهمية الحفاظ على معايير عالية من الدقة والموثوقية.

تعليقات